Dossier | Au-delà de l’achat : les nouveaux territoires de la consommation

Du marketing digital au capitalisme de surveillance

Dans un monde saturé d’informations, les technologies numériques transforment chaque interaction en ligne en donnée exploitable utilisée pour capter l’attention, modéliser les comportements pour les guider. Elles redéfinissent ainsi silencieusement les règles du jeu démocratique.

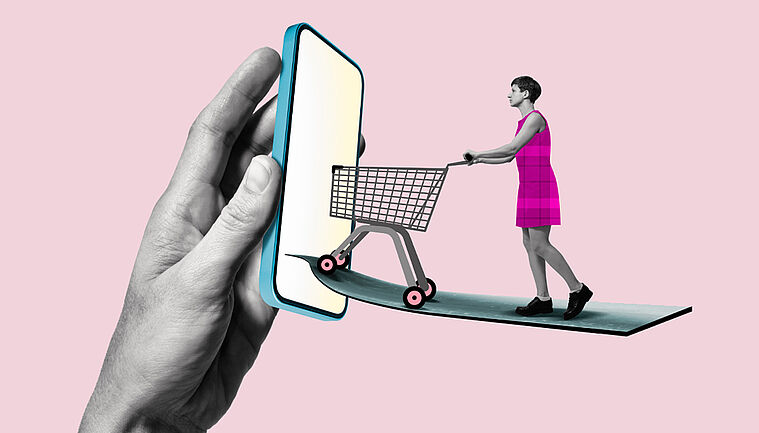

Dans un contexte de concurrence exacerbée, la compréhension fine du comportement des consommateurs est devenue un levier stratégique essentiel. Les grandes entreprises du numérique ont rapidement compris la valeur des données, mais aussi des traces laissées sur internet. Des dispositifs techniques ont été inventés pour déduire des informations personnelles à partir de signaux apparemment anodins, en croisant des données sur les préférences d’achat, les caractéristiques physiques ou les habitudes de navigation (Einhorm, 2021).

Le marketing contemporain s’est approprié les outils numériques pour transformer chaque interaction en ligne en source d’information exploitable (Chaffey & Ellis-Chadwick, 2020). Chaque like, recherche sur le net ou déplacement géographique est devenu une donnée exploitable pour affiner la connaissance des profils des clients potentiels permettant une publicité ciblée, en adaptant les contenus et les recommandations qui leur sont présentés.

L’agrégation massive de données, combinée à l’usage d’outils algorithmiques avancés, permet de modéliser et d’exploiter les comportements à grande échelle (Boyd & Crawford, 2012). Ces Big Data, monétisées auprès d’annonceurs ou de plateformes, servent à influencer les décisions futures des consommateurs, rendant les comportements plus prévisibles et donc plus rentables pour les acteurs économiques (Trzaskowski, 2022).

Capter l’attention et influencer les comportements

Dans un monde saturé d’informations, la véritable rareté n’est plus l’information elle-même, mais l’attention. Ainsi, la surabondance de contenus crée un nouveau défi : capter, retenir et orienter l’attention des individus. L’économie de l’attention n’est pas née avec le numérique mais les technologies actuelles en renforcent les mécanismes grâce à leurs capacités de calcul, de ciblage et de prédiction (Andrejevic, 2012; Citton, 2014). Selon Marion Thain, Directrice du Centre for Attention Studies au King's College, “ce qui est nouveau avec les technologies numériques, c’est la capacité croissante de surveiller ce vers quoi l’attention individuelle est dirigée.”

Les stratégies de design persuasif se sont multipliées pour attirer l’attention et influencer les décisions des utilisateurs (Alombert et Kokshagina, 2022) : les recommandations personnalisées d’Amazon, les liens sponsorisés affichés par Google, ou encore les interfaces de certaines applications en sont des exemples emblématiques. Tous ces dispositifs sont conçus pour guider discrètement les comportements en réduisant au maximum l’effort nécessaire à l’action.

Dans ce système, les données personnelles deviennent une ressource stratégique. Les modèles commerciaux fondés sur cette extraction de données ne se contentent pas d’anticiper les besoins exprimés, mais cherchent à induire les désirs et à conditionner les comportements dans un objectif de maximisation du profit (Tufekci, 2015).

Un nouveau capitalisme fondé sur une infrastructure invisible de contrôle

Moteurs de recherche, réseaux sociaux, assistants vocaux ou services de cartographie sont devenus les relais d’une collecte automatisée et continue de données personnelles et comportementales. L’utilisateur est placé dans une position de vulnérabilité cognitive, souvent inconscient de l’ampleur des données collectées sur lui et de leur usage.

Les mécanismes de surveillance, intégrés au cœur des interfaces, de manière fluide, voire ludique, constituent le socle d’une dynamique économique puissante. Les entreprises engagées dans ce système – Google, Meta, Amazon, entre autres – ne se contentent pas d’offrir des services ; elles transforment chaque interaction en source de valeur marchande.

Cette dynamique de collecte, d’analyse et de valorisation des données s’inscrit dans ce que Shoshana Zuboff a nommé le capitalisme de surveillance : un système économique fondé non plus sur la production matérielle, mais sur la captation de l’expérience humaine comme matière première (Zuboff, 2019). Dans ce modèle, l’individu devient une ressource exploitable, une source inépuisable de données. Ces données alimentent des systèmes prédictifs capables d’analyser, d’anticiper, et finalement de manipuler subtilement les préférences et les désirs individuels.

L’exemple de Pokémon Go, jeu mobile à succès, est symptomatique. Derrière son apparence inoffensive, cette application a démontré sa capacité à influencer les trajectoires physiques de ses utilisateurs, en les incitant à se rendre dans des lieux partenaires commerciaux, tels que des restaurants ou des boutiques.

Dans ce modèle, la surveillance n’est pas une finalité en soi, mais un vecteur de rentabilité : les données collectées deviennent des biens échangés sous la promesse d’un accès privilégié à l’esprit du consommateur. Le cas de Google est emblématique de ce capitalisme. Initialement moteur de recherche, Google a fait évoluer son modèle économique avec une technologie de publicité ciblée, reposant sur l’analyse des historiques de navigation et des taux de clics (Zuboff, 2019). La puissance économique de l’entreprise repose encore actuellement sur un écosystème d’applications gratuites qui captent en permanence des données comportementales.

Ainsi, la promesse de liberté qu’offre l’économie numérique dissimule un régime de surveillance invisible, d’autant plus puissant qu’il est intégré aux habitudes et aux gestes les plus anodins.

Enjeux éthiques et menaces pour la démocratie

Le capitalisme de surveillance se distingue des formes de contrôle traditionnelles par sa nature furtive et systémique. Contrairement à une autorité visible, coercitive ou centralisée, il s'appuie sur des dispositifs technologiques discrets, intégrés aux infrastructures numériques du quotidien. Ce phénomène, que Shoshana Zuboff nomme le Big Other, désigne une nouvelle forme de pouvoir algorithmique, omniprésente mais insaisissable, qui surveille, oriente et influence les comportements humains sans confrontation apparente.

En réduisant l’individu à un ensemble de comportements prévisibles, le capitalisme de surveillance fragilise la notion de libre arbitre (Rouvroy et Berns, 2016). Les décisions, de plus en plus influencées par des environnements informationnels conçus sur mesure, deviennent moins le fruit d’un choix éclairé qu’une architecture cognitive biaisée. Le pouvoir de manipuler les conditions de la décision constitue une forme subtile de domination, difficile à détecter, et encore plus à contester (Helbing et al., 2019).

De plus, les pratiques de personnalisation algorithmique restreignent souvent l’horizon informationnel de l’utilisateur à un ensemble limité de contenus reflétant ses intérêts passés. Les plateformes de recommandation et moteurs de recherche créent ainsi des bulles informationnelles où les opinions divergentes et les alternatives commerciales tendent à disparaître (Lyon, 2019).

De la consommation aux choix politiques

Enfin, la concentration des données entre les mains de quelques grandes entreprises technologiques crée un déséquilibre inédit entre les citoyens et les acteurs économiques. Ces entreprises, parfois présents à toutes les étapes de la chaîne de valeur du marketing digital, disposent d’un savoir comportemental asymétrique, qui leur confère un pouvoir d’anticipation et d’influence sans précédent. Ce phénomène menace la souveraineté individuelle, mais aussi celle des États, souvent dépassés par la vitesse d’évolution technologique et les stratégies d’opacité de ces firmes (Morozov, 2013).

À cela s’ajoute le risque de dérives autoritaires : les outils de surveillance, développés initialement à des fins commerciales, peuvent être détournés à des fins politiques. Les cas de censure algorithmique, de manipulation électorale ou de profilage idéologique soulignent les dangers d’un modèle dans lequel la frontière entre le secteur privé et le contrôle social devient poreuse (Tufekci, 2015).

Le capitalisme de surveillance ne remet donc pas seulement en question les modalités de consommation, il affecte les fondements mêmes de la démocratie (Vaidhyanathan, 2018). Dans ce contexte, des initiatives émergent pour contrer ces dérives : régulations sur la protection des données personnelles, appels à la transparence algorithmique, développement d’alternatives éthiques aux grandes plateformes (Andrew and Baker, 2019). Toutefois, l’efficacité de ces mesures reste limitée face à la puissance économique, technique et symbolique des géants du numérique (Rouvroy, 2016). Malgré les nombreuses alertes émises, soulignant l’urgence de repenser notre rapport aux technologies numériques, de renforcer les régulations et d'imaginer des modèles alternatifs, le capitalisme du surveillance ne fait que s’accentuer, conduisant à questionner la comptabilité de la puissance du numérique avec nos droits fondamentaux et les principes démocratiques.

Ce contenu est publié sous licence Creative Commons

Notes & Références

- Alombert A. et Kokshagina O. (2022). Votre attention, s’il vous plaît ! Quels leviers face à l’économie de l’attention ?, Conseil National du Numérique

- Andrejevic, M. (2012). Ubiquitous surveillance, in Lyon D., Haggerty K., Ball K. (ed.), The Routledge Handbook of Surveillance Studies, Routledge, Abingdon Oxon UK, 91-98.

- Andrew, J., and Baker, M. (2019). The General Data Protection Regulation in the Age of Surveillance Capitalism, Journal of Business Ethics

- Boyd, D., & Crawford, K. (2012). Critical Questions for Big Data: Provocations for a cultural, technological, and scholarly phenomenon. Information, Communication & Society, 15(5), 662–679.

- Chaffey, D., & Ellis-Chadwick, F. (2020). Digital Marketing (7th ed.). Pearson Education.

- Citton, P.-Y. (2014). Pour une écologie de l’attention, Seuil.

- Einhorm, M. (2021). The Machine Age of Customer Insight, Emerald Publishing Limited.

- Helbing, D., Frey, B. S., Gigerenzer, G., Hafen, E., Hagner, M., Hofstetter, Y., ... & Zwitter, A. (2019). Will democracy survive big data and artificial intelligence? In Towards Digital Enlightenment. Springer, 73-98.

- Lyon, D. (2019). Surveillance capitalism, surveillance culture and data politics, in Bigo D., Isin E, and E. Ruppert, Data Politics, Worlds, Subjects, Rights, Routledge, 64-77

- Morozov, E. (2013). To Save Everything, Click Here: The Folly of Technological Solutionism. PublicAffairs.

- Rouvroy, A. et Berns, T. (2013). Gouvernementalité algorithmique et perspectives d’émancipation, dans Politique des algorithmes: Les métriques du web, Réseaux, La découverte, 2013/1 n° 177, p. 163-196

- Rouvroy, A. (2016). “Of data and men”, fundamental rights and freedoms in a world of big data, BUREAU OF THE CONSULTATIVE COMMITTEE OF THE CONVENTION FOR THE PROTECTION OF INDIVIDUALS WITH REGARD TO AUTOMATIC PROCESSING OF PERSONAL DATA, Conseil de l’Europe, T-PD-BUR(2015)09REV.

- Trzaskowski, J. (2022). Data-driven value extraction and human well-being under EU law, Electronic Markets

- Tufekci, Z. (2015). Algorithmic harms beyond Facebook and Google: Emergent challenges of computational agency. Colorado Technology Law Journal, 13(203).

- Vaidhyanathan, S. (2022). Antisocial Media: How Facebook Disconnects Us and Undermines Democracy. Oxford University Press.

- Zuboff, S. (2019). The Age of Surveillance Capitalism: the fight for a human future at the new frontier of power. London : Profile Books,

À lire aussi

Derrière l’image spectaculaire des crises, Anouck Adrot traque ce qui, en amont, conditionne la capacité des organisations à agir. Maîtresse de...

L’intelligence artificielle générative promet de transformer le conseil financier. Mais ses capacités réelles restent mal connues. À l’Université...

L’intelligence artificielle promet des gains de productivité considérables. Mais qui en bénéficiera ? La réponse dépend de la nature de l’IA, de la...